本篇目录:

- 1、youtube正在加载用户代码

- 2、从网站抓取数据的3种最佳方法

- 3、用爬虫抓取网页得到的源代码和浏览器中看到的不一样运用了什么技术...

- 4、如何用python爬取网站数据?

- 5、如何通过网络爬虫获取网站数据?

- 6、python爬虫如何分析一个将要爬取的网站?

youtube正在加载用户代码

1、youtube加载不出来的原因:网络连接问题。如果用户的网络连接不稳定或断开,就无法打开YouTube。尝试检查自己的网络连接,确保用户的设备已连接到可用的网络。浏览器问题。

2、网络连接问题:如果网络连接不稳定或速度过慢,可能就会导致YouTube一直在加载,在这种情况下,可以尝试重新连接网络或使用其他网络设备测试是否能够正常访问YouTube。

3、①可能是用户设备的网络状况不稳定,导致在连接该软件时,出现加载超时等情况。②可能是当前该软件的服务器端处于繁忙等状态。不能及时的为用户提供相应的服务。③可能是用户使用的软件版本过低。

从网站抓取数据的3种最佳方法

网络爬虫:网络爬虫是一种自动化的程序,它可以按照预设的规则浏览和抓取互联网上的数据。网络爬虫的工作方式类似于搜索引擎的爬虫,遍历网页并提取所需的信息。

互联网采集数据有以下几种常见的方法: 手动复制粘贴:通过手动复制网页上的数据,然后粘贴到本地文件或数据库中。 编写爬虫程序:使用编程语言编写爬虫程序,模拟人类在浏览器中访问网页的行为,自动抓取网页上的数据。

调查问卷 这是一种广泛使用的数据采集方法,通过设计问卷,针对特定群体或目标受众进行调查。问卷可以包含多种类型的问题,包括选择题、开放性问题等,适用于收集大量结构化数据。

数据采集方法主要有以下几种: 网络爬虫:网络爬虫是一种自动化工具,可以自动从互联网上抓取数据。它通过模拟正常的人类用户访问网页的行为,使用各种编程语言和工具来解析网页并提取所需的数据。

在抓取大量数据后,需要选择一个适合自己需求的存储方式。常见的存储方式有MySQL、MongoDB、Redis等。每种方式都有自己的优缺点,需要根据自己的情况进行选择。

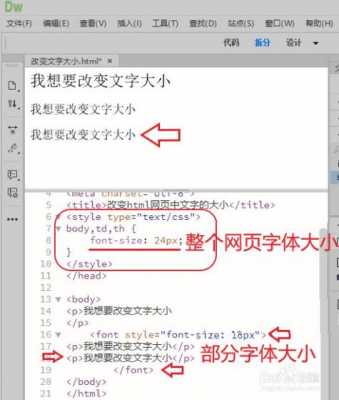

用爬虫抓取网页得到的源代码和浏览器中看到的不一样运用了什么技术...

提取信息 获取到的网页源码内包含了很多信息,想要进提取到我们需要的信息,则需要对源码还要做进一步筛选。

大数据时代,要进行数据分析,首先要有数据源,通过爬虫技术可以获得等多的数据源。

另外,所有被爬虫抓取的网页将会被系统存贮,进行一定的分析、过滤,并建立索引,以便之后的查询和检索;对于聚焦爬虫来说,这一过程所得到的分析结果还可能对以后的抓取过程给出反馈和指导。

如何用python爬取网站数据?

用python爬取网站数据方法步骤如下:首先要明确想要爬取的目标。对于网页源信息的爬取首先要获取url,然后定位的目标内容。先使用基础for循环生成的url信息。

python爬虫,需要安装必要的库、抓取网页数据、解析HTML、存储数据、循环抓取。安装必要的库 为了编写爬虫,你需要安装一些Python库,例如requests、BeautifulSoup和lxml等。你可以使用pip install命令来安装这些库。

安装Python和相关库 要使用Python进行网页数据抓取,首先需要安装Python解释器。可以从Python官方网站下载并安装最新的Python版本。安装完成后,还需要安装一些相关的Python库,如requests、beautifulsoup、selenium等。

爬取网页数据,需要一些工具,比如requests,正则表达式,bs4等,解析网页首推bs4啊,可以通过标签和节点抓取数据。

)首先确定需要爬取的网页URL地址;2)通过HTTP/HTTP协议来获取对应的HTML页面;3)提取HTML页面里有用的数据:a.如果是需要的数据,就保存起来。b.如果是页面里的其他URL,那就继续执行第二步。

如何通过网络爬虫获取网站数据?

广度优先遍历策略 广度优先搜索和深度优先搜索的工作方式正好是相对的,其思想为:将新下载网页中发现的链接直接插入待抓取URL队列的末尾。

以下是使用Python编写爬虫获取网页数据的一般步骤: 安装Python和所需的第三方库。可以使用pip命令来安装第三方库,如pip install beautifulsoup4。 导入所需的库。例如,使用import语句导入BeautifulSoup库。

拿爬取网站数据分析:用浏览器开发者工具的Network功能分析对应的数据接口或者查看源代码写出相应的正则表达式去匹配相关数据 将步骤一分析出来的结果或者正则用脚本语言模拟请求,提取关键数据。

设置翻页规则。如果需要爬取多页数据,可以设置八爪鱼采集器自动翻页,以获取更多的数据。 运行采集任务。确认设置无误后,可以启动采集任务,让八爪鱼开始爬取网页数据。 等待爬取完成。

以下是网络爬虫的入门步骤: 确定采集目标:首先需要明确你想要采集的数据是什么,以及数据来源是哪个网站或网页。 学习HTML和XPath:了解HTML和XPath的基本知识,这是进行网页解析和数据提取的基础。

python爬虫如何分析一个将要爬取的网站?

爬取网页数据,需要一些工具,比如requests,正则表达式,bs4等,解析网页首推bs4啊,可以通过标签和节点抓取数据。

写文章最多的top30 爬虫架构 爬虫架构图如下:说明:选择一个活跃的用户(比如李开复)的url作为入口url.并将已爬取的url存在set中。

Python 中可以进行网页解析的库有很多,常见的有 BeautifulSoup 和 lxml 等。

以下是使用Python编写爬虫获取网页数据的一般步骤: 安装Python和所需的第三方库。可以使用pip命令来安装第三方库,如pip install beautifulsoup4。 导入所需的库。例如,使用import语句导入BeautifulSoup库。

首先要明确想要爬取的目标。对于网页源信息的爬取首先要获取url,然后定位的目标内容。先使用基础for循环生成的url信息。然后需要模拟浏览器的请求(使用request.get(url)),获取目标网页的源代码信息(req.text)。

到此,以上就是小编对于网站加载代码抓取用户信息失败的问题就介绍到这了,希望介绍的几点解答对大家有用,有任何问题和不懂的,欢迎各位老师在评论区讨论,给我留言。